Wszystko, co chcieliście wiedzieć o LLM-ach, ale baliście się zapytać!

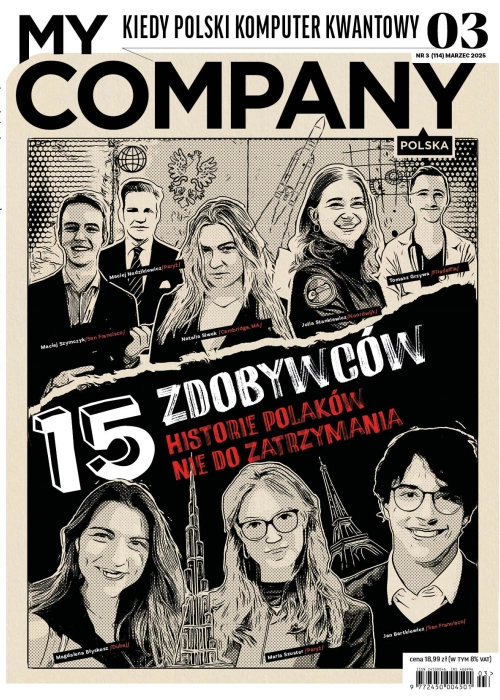

z miesięcznika „My Company Polska”, wydanie 3/2025 (114)

Zyskaj dostęp do bazy artykułów z „My Company Polska” Zamów teraz!

Czym są LLM-y?

Z języka angielskiego to po prostu duże modele językowe. Duże, ponieważ odnoszą się do rozwiązania operującego na dużych zbiorach danych i posiadającego dużą liczbę parametrów, a modele językowe, gdyż przyjmowanymi danymi jest tekst – a następnie inny tekst jest przez nie „wypluwany”. To w sumie ciekawe, że ludzie spodziewali się, że sztuczna inteligencja przyjdzie do nas dzięki zaawansowanym robotom rodem z „Terminatora”, a otrzymaliśmy ją pod postacią czata tekstowego.

Przed rozmową stwierdziłeś, że współczesny LLM jest takim trochę człowiekiem renesansu.

Tak, ponieważ duże modele językowe znają się po trochu na wszystkim, w zależności od tego, na jakich danych były trenowane i jak dużych zbiorów do tego użyto. Oczywiście LLM-y nie będą tracić na znaczeniu, natomiast wydaje mi się, że przyszłość należy do mniejszych modeli, ale wyspecjalizowanych w konkretnych zadaniach. Stąd rosnące znaczenie agentowej sztucznej inteligencji, obecnie szczególnie popularnej w takich dziedzinach jak prawo, medycyna czy bankowość. Kluczowy jest język, jakim posługują się agenci, np. język polski jest bardzo specyficzny, ma mnóstwo idiomów, więc trudno o agentową sztuczną inteligencję, która bez znajomości polskiego będzie dobrze odnajdywać się w polskim systemie prawnym.

Jeśli LLM jest Leonardem da Vinci, który namaluje obraz, zaprojektuje maszynę czy wyrzeźbi statuę, tak agent AI jest Claude Monetem specjalizującym się w impresjonistycznych pejzażach.

Czy Polska potrzebuje własnego LLM?

Teoretycznie tak, zwłaszcza że mamy w kraju prężnie działające firmy technologiczne i fantastycznych programistów, którzy zresztą przewodzą rewolucji AI na całym świecie, czego idealnym przykładem jest zespół OpenAI. Wydaje mi się, iż nie da się zbudować konkurencyjność kraju na międzynarodowej arenie AI, jeśli ten kraj nie ma własnego dużego modelu językowego. W przypadku Polski i tego, co się wydarzyło na skutek jednej z ostatnich decyzji administracji Joe Bidena dotyczącej ograniczenia dostępności chipów, kiedy po prostu do pewnego stopnia wykluczono nas z wyścigu technologicznego, własny LLM może być szczególnie kluczowy. Nie spodziewam się, że duży polski model językowy powstanie w najbliższym czasie, jednak nie wykluczam takiego scenariusza w dalszej przyszłości. Dobrym przykładem tego, że da się robić nad Wisłą interesujące projekty w tym kierunku jest chociażby Bielik. Polacy naprawdę potrafią efektywnie wykorzystywać dostępne narzędzia, nie musimy od razu wymyślać koła na nowo.

Wielu ekspertów AI – z prof. Piotrem Sankowskim na czele – uważa, że nie stać nas na własny duży model językowy.

Co jest prawdą, natomiast rozwój sztucznej inteligencji jest tak dynamiczny, że wkrótce może się okazać, że da się zbudować LLM w sposób tańszy, optymalny, inaczej dysponując dostępnymi zasobami. Oczywiście przed rozpoczęciem prac nad własnym modelem językowym trzeba będzie przeanalizować, na ile taka inwestycja nam się opłaci, zwłaszcza, jeśli w takie przedsięwzięcie zaangażują się prywatni inwestorzy, oczekujący oczywiście zwrotu z inwestycji.

Rozwój AI nad Wisłą jest tak istotny, ponieważ Polska potrzebuje automatyzacji w wielu dziedzinach, chociażby w administracji publicznej czy służbie zdrowia. I potrzebuje, aby ten proces był w pełni bezpieczny, czyli najlepiej na własnych narzędziach, rozwiązaniach czy lokalnych serwerach. To, że ChatGPT jest obecnie w zasadzie wiodącym LLM na świecie, nie oznacza, że jest odpowiedni do wdrożenia w każdej branży, na każdym rynku. Nie wyobrażam sobie, aby duży polski bank implementował istotne rozwiązanie dla klienta w oparciu o ChatGPT.

W ostatnich tygodniach sporo dyskutowano o rządowych działaniach i spotkaniach premiera Donalda Tuska z przedstawicielami Google’a czy Microsoftu. Czy to może w jakiś istotny sposób wpłynąć na prace nad polskim LLM?

Nie wydaje mi się, żeby miało to jakieś kluczowe znaczenie, natomiast wydarzenia na najwyższych szczeblach władzy z pewnością wpływają na całą branżę technologiczną. Być może teraz innowatorzy pracujący w Polsce nad modelami językowymi będą musieli wprowadzić delikatne korekty do swoich strategii, ale nie spodziewam się fundamentalnych zmian. Wszyscy powinniśmy dążyć do tego, by dostarczać rozwiązania oparte na polskich danych, przetwarzane przez polskie serwery, z pomocą polskich deweloperów.

Zauważ, że większość interesujących rodzimych projektów z zakresu AI – chociażby wspomniany już Bielik – to inicjatywy oddolne. Ludziom w naszym kraju naprawdę się chce i widzimy to nawet po osobach zgłaszających się do pracy w Asseco. Liczba kandydatów do rozwijania się w ramach naszych działów AI stale rośnie, ich umiejętności zresztą też.

A co, jeśli bańka AI pęknie – bo chyba się zgodzimy, że kiedyś pęknie – i tych oddolnych inicjatyw będzie mniej, ponieważ eksperci skupią się na innych projektach?

Duże modele językowe na pewno przeżywają teraz swoje pięć minut i w sumie nikt nie wie, co będzie dalej – może będzie szósta minuta, a może akcenty zostaną przełożone gdzieś indziej. W dyskutowaniu o przyszłości sztucznej inteligencji blisko mi do prof. Dragana, który jest świadom dynamicznych zmian, więc niechętnie kreśli jednoznaczne scenariusze. Zresztą, powiem szczerze, że kiedy udostępniono pierwsze wersje ChatGPT to ja nie do końca wierzyłem w tę technologię – teraz w zasadzie nie wyobrażam sobie bez niej codziennej pracy, natomiast w Asseco skupiam się m.in. na tym, jak LLMy mogą być wdrażane przez biznes.

Celem sztucznej inteligencji nie jest odebranie ludziom pracy – ona jest najskuteczniejsza wtedy, kiedy pomaga im w wykonywaniu powtarzalnych, często bardzo nudnych obowiązków. AI może zaplanować ludziom dietę, ale nie sprawi, że przestaną podjadać między posiłkami. To, jak będziemy korzystać z dostępnych narzędzi w największym stopniu zależy od nas.

Jakie podejście do dużych modeli językowych charakteryzuje Asseco? Macie bardzo bogate doświadczenie we wdrażaniu ich w przedsiębiorstwach.

Zapewniamy pełne wsparcie w takich procesach, a także nasze autorskie narzędzia sprawiające, że takie wdrożenie jest efektywne i wyskalowane zgodnie z potrzebami danej organizacji. To ważne, ponieważ od przetestowania rozwiązania do jego w pełni efektywnego wdrożenia jest bardzo długa droga. Prosty przykład: jeśli konkretne narzędzie działa, kiedy używa go 5-osobowy zespół, nie znaczy, że będzie działać, jeśli zacznie z niego korzystać 100-osobowa organizacja. Asseco pomaga przy takim przygotowaniu środowiska firmowego, by uniknąć tego typu problemów. Oczywiście jesteśmy obecni na każdym etapie wdrożenia, a przy tym służymy wsparciem już po implementacji.

Jednym z przykładów udanego wdrożenia z naszą pomocą są agenci AI w jednym ze szpitali. Rozwiązanie znacząco skróciło proces umawiania się na wizytę – a do pewnego stopnia również kolejki – ponieważ znalezienie odpowiedniego terminu z pomocą sztucznej inteligencji jest około dwa razy krótsze niż z pomocą człowieka. Oczywiście w placówce nadal pracują ludzie, ale są wspierani innowacyjnymi narzędziami.

Na ile przedsiębiorcy są świadomi swoich potrzeb, kiedy zgłaszają się do was z prośbą o pomoc we wdrożeniu AI?

Są właściwie trzy grupy klientów: tacy, którzy nie mają pojęcia o sztucznej inteligencji, tacy, którzy coś tam wiedzą (często nawet całkiem sporo) oraz tacy, którzy mają wiedzę, ale najczęściej opartą na błędnych źródłach. Oczywiście wspieramy każdą z tych grup, oferujemy także szkolenia budujące poziom wiedzy na temat nowych technologii.

Bardzo cieszymy się z każdego użytkownika, którego w jakimś stopniu zaraziliśmy zajawką na AI, bo to po prostu procentuje później w szerszym kontekście. Nie ma sensu wdrażać sztucznej inteligencji na własną rękę, skoro można skorzystać ze wsparcia doświadczonych partnerów, zwłaszcza że rewolucja AI postępuje tak szybko, że rozwiązanie, które jest skutecznego jednego dnia, za miesiąc może okazać się całkowicie nieefektywne.

Więcej możesz przeczytać w 3/2025 (114) wydaniu miesięcznika „My Company Polska”.