Smartglassy, które zdiagnozują Alzheimera i pomogą osobom niedowidzącym. Cornell University prezentuje dwie technologie

GazeTrak i EyeEcho – monitorowanie wyrazu twarzy w sposób ciągły

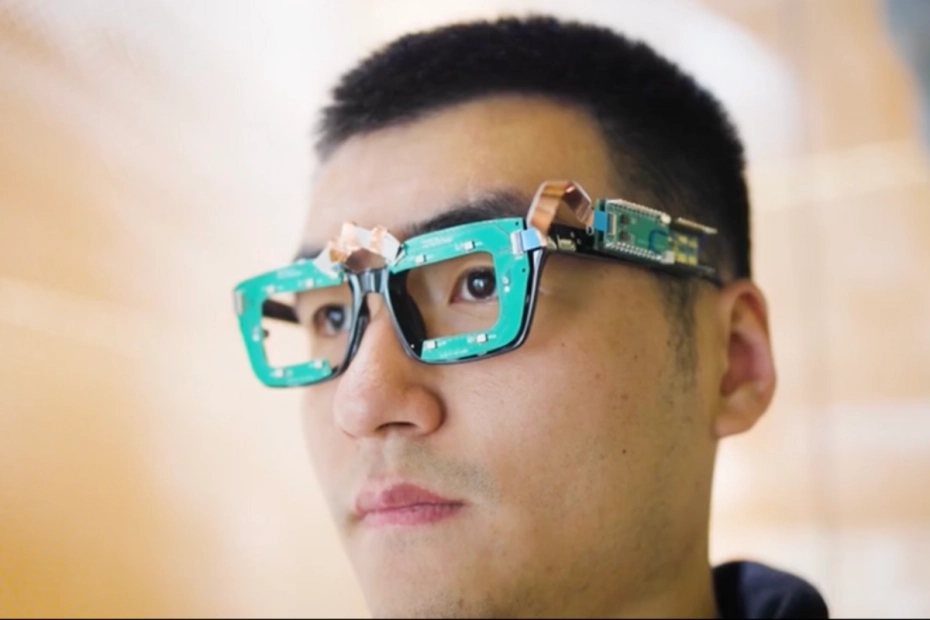

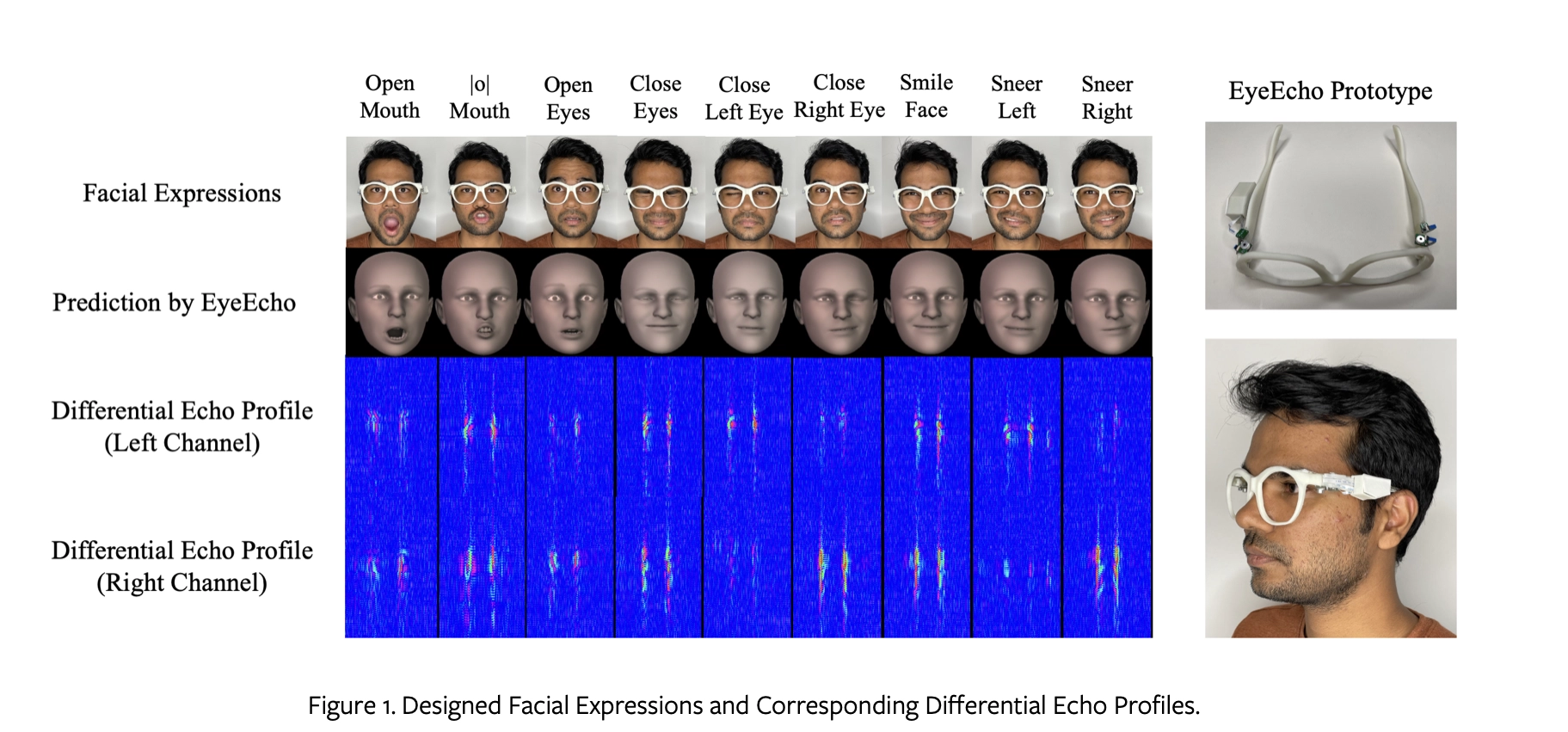

Oba rodzaje smartglassów używają głośników i mikrofonów zamontowanych na oprawce okularów, aby odbijać niesłyszalne fale dźwiękowe od twarzy i odbierać odbite sygnały spowodowane ruchami twarzy i oczu. GazeTrak jest systemem śledzenia wzroku, który opiera się na sygnałach akustycznych, natomiast EyeEcho, jest systemem opartym na okularach, który stale i dokładnie wykrywa mimikę twarzy i odtwarza ją za pomocą awatara w czasie rzeczywistym. Urządzenia mogą wytrzymać kilka godzin na baterii smartglassa i ponad jeden dzień na zestawie VR.

– Jest mały, tani i ma bardzo małą moc, więc możesz nosić go na smartglassach każdego dnia – nie zabije baterii – ocenił Cheng Zhang, adiunkt informatyki na Cornell University. Zhang kieruje Laboratorium Inteligentnych Interfejsów Komputerowych dla Przyszłych Interakcji (SciFi), które stworzyło oba urządzenia.

Odtwarzanie mimiki twarzy i ruchów oczu, aby mieć lepsze interakcje z innymi użytkownikami

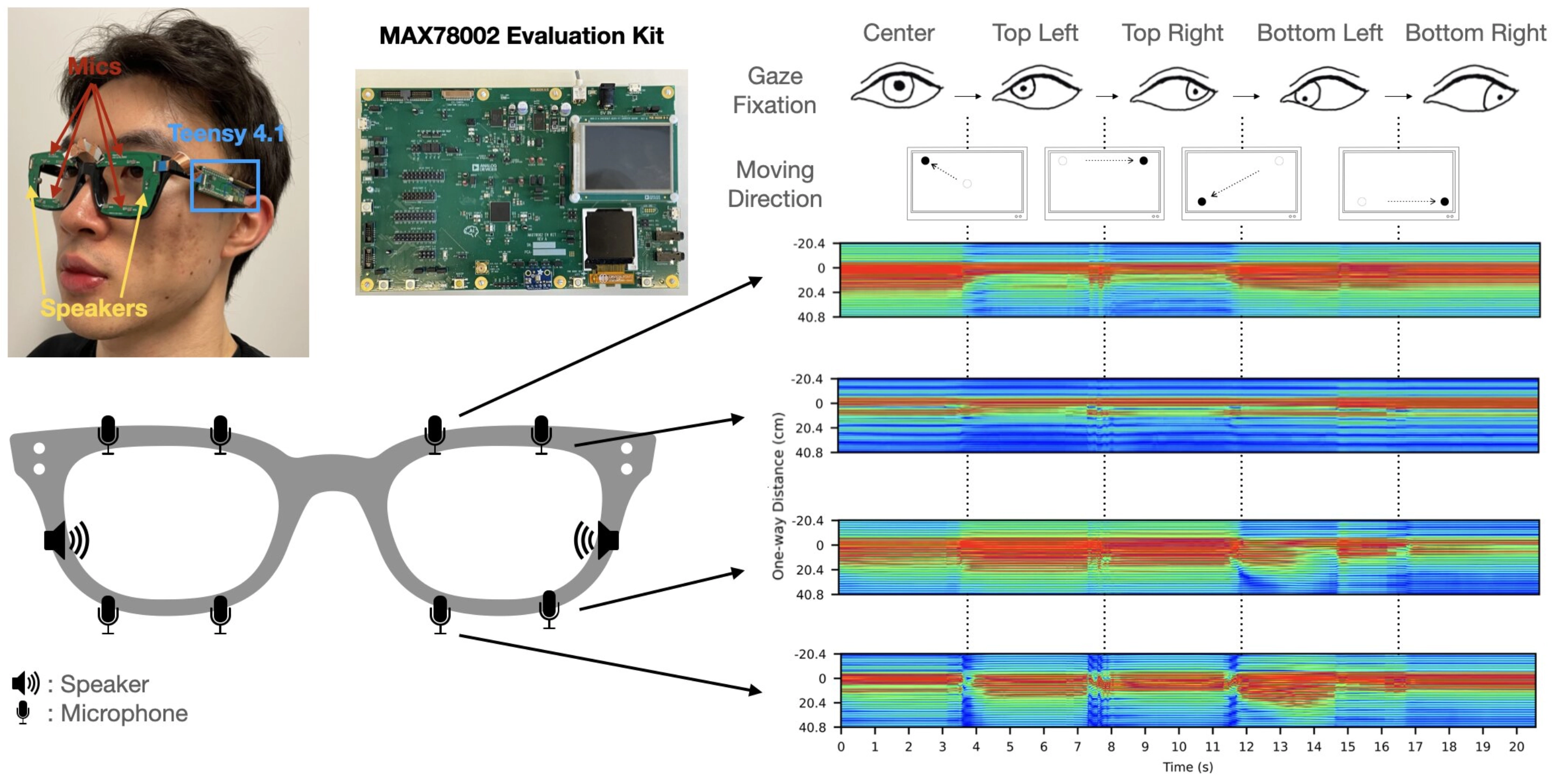

W przypadku GazeTrak naukowcy ustawili jeden głośnik i cztery mikrofony wokół wnętrza każdej oprawki okularów, aby odbijać i odbierać fale dźwiękowe z gałki ocznej i okolic oczu. Powstałe sygnały dźwiękowe są podawane do deep-learningowego pipeline'u, który wykorzystuje sztuczną inteligencję do ciągłego monitorowania kierunku spojrzenia osoby.

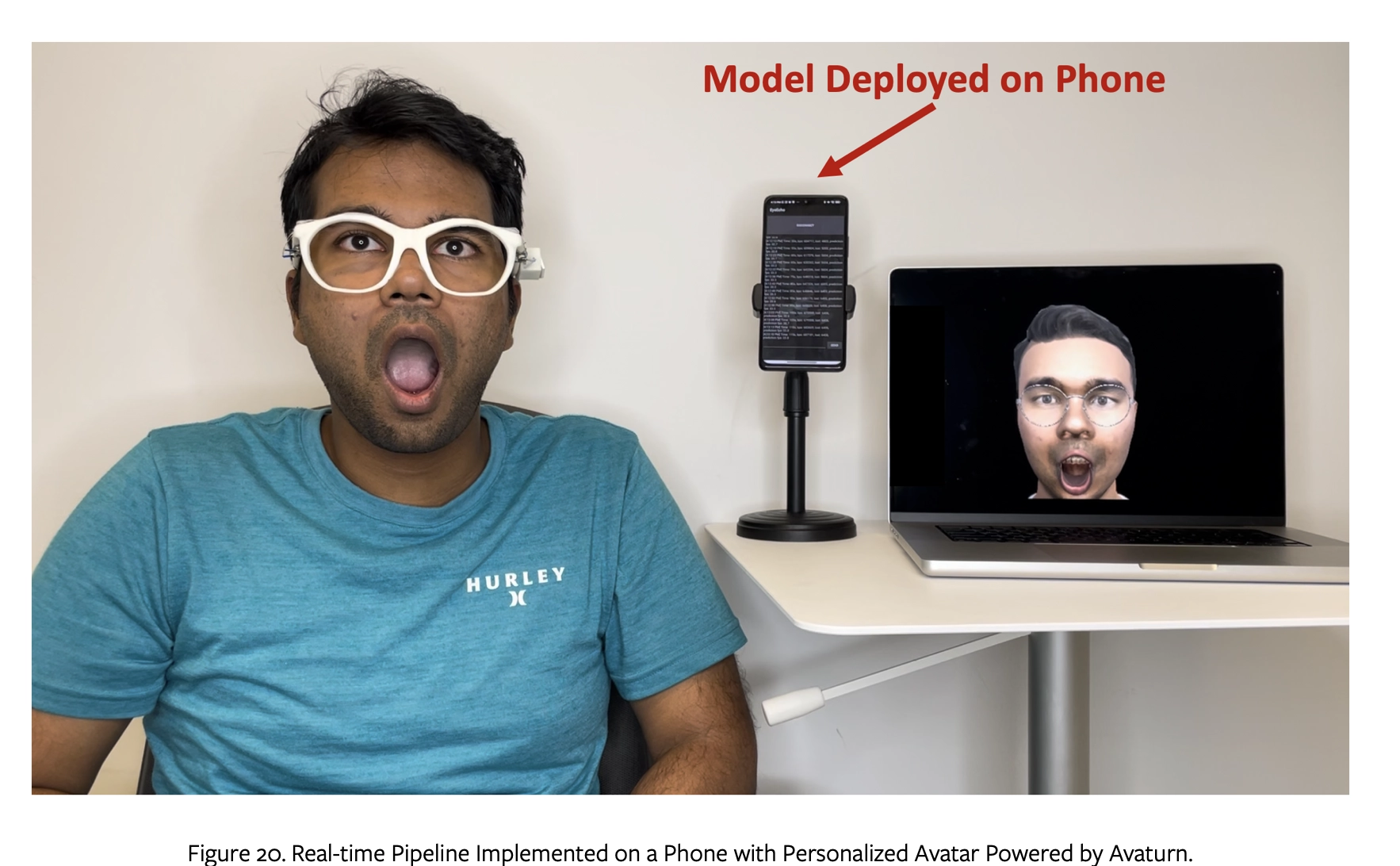

Z kolei EyeEcho posiada jeden głośnik i jeden mikrofon znajdujące się obok zawiasów okularów. Są skierowane w dół, aby złapać ruch skóry w miarę zmian wyrazu twarzy. Odbite sygnały są również interpretowane za pomocą sztucznej inteligencji.

Rozmowa video w hałaśliwej okolicy, albo czytanie

Dzięki technologii użytkownicy mogą prowadzić rozmowy wideo bez użycia rąk przez awatara, nawet w hałaśliwym miejscu. Dodajmy, że niektóre smartglassy mają zdolność rozpoznawania twarzy lub rozróżniania kilku konkretnych wyrazów twarzy, ale żadne nie śledzą wyrazów w sposób ciągły, tak jak EyeEcho.

Dodatkowo GazeTrak może być używany z czytnikami ekranu do odczytu fragmentów tekstu dla osób niedowidzących, które np. zapoznają się z witryną internetową.

Diagnozowanie chorób neurodegeneracyjnych

GazeTrak i EyeEcho mogą również potencjalnie pomóc w diagnozowaniu lub monitorowaniu chorób neurodegeneracyjnych, takich jak Alzheimer i Parkinson. Przy tych schorzeniach pacjenci często mają nieprawidłowe ruchy gałek ocznych i mniej wyraziste twarze, a tego typu technologia może śledzić postęp choroby w zaciszu domowym pacjenta.

GazeTrak będzie zaprezentowany jesienią na Annual International Conference on Mobile Computing and Networking, a EyeEcho w maju na Association of Computing Machinery CHI conference on Human Factors in Computing Systems

Przeczytaj także: To powinni być nowi idole. Najlepsi polscy innowatorzy

Top 10 medtechów, czyli firmy, które leczą. Ranking najlepszych startupów

Hashimoto, rak piersi, demencja – Polacy leczą choroby, z którymi medycyna dotychczas sobie nie radziła. Rodzime startupy rosną w siłę i zapowiadają dalszy rozwój. Opisujemy 10 polskich medtechów, na które warto zwrócić uwagę.